Firmy, urzędy i zwykli ludzie właśnie wchodzą na prawny grunt bez zasad

Jeszcze dwa lata temu sztuczna inteligencja była dla wielu ciekawostką. Dziś stała się codziennym narzędziem pracy. Pracownicy wrzucają do ChatGPT, Grok, Cloud projekty umów, przedsiębiorcy analizują strategie sprzedaży, urzędnicy redagują pisma, a dziennikarze porządkują dokumenty i notatki.

Problem w tym, że ogromna część użytkowników zaczęła traktować AI jak prywatnego doradcę. Albo cyfrowy sejf.

I właśnie tutaj pojawia się pytanie, które coraz częściej wraca w świecie prawa i cyberbezpieczeństwa:

Czy rozmowy z AI mogą stać się dowodem w sądzie?

Odpowiedź brzmi: tak — i to znacznie szybciej, niż wielu osobom się wydaje.

ilustracja do artykulu rozmowa z ai moze byc dowodem w sprawie

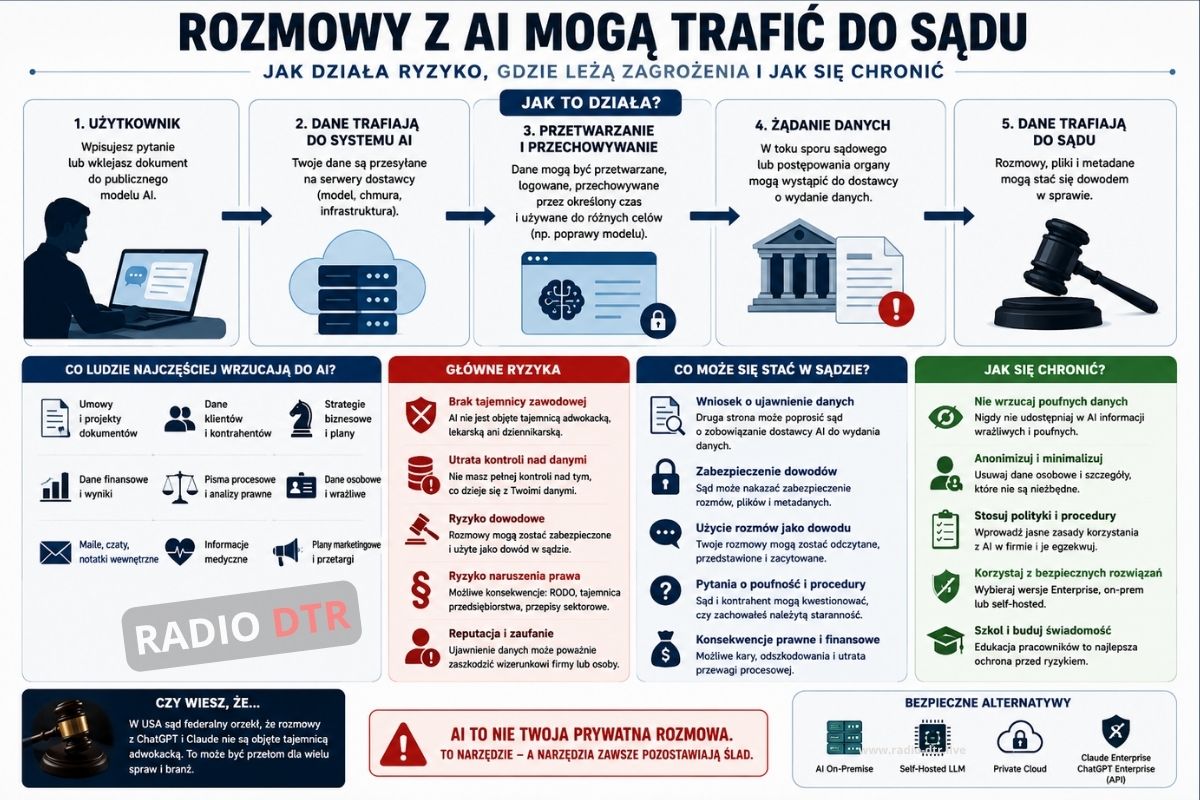

ilustracja do artykulu rozmowa z ai moze byc dowodem w sprawie

Skąd wzięła się dyskusja?

W amerykańskiej przestrzeni prawnej coraz częściej pojawiają się sprawy dotyczące danych przetwarzanych przez modele sztucznej inteligencji. Głośnym echem odbiły się informacje związane z federalnym postępowaniem w USA, w którym zwrócono uwagę, że rozmowy prowadzone z popularnymi modelami AI nie są objęte ochroną analogiczną do tajemnicy adwokackiej.

To bardzo ważne rozróżnienie.

Jeżeli klient rozmawia z adwokatem — obowiązuje tajemnica zawodowa.

Jeżeli pacjent rozmawia z lekarzem — istnieje tajemnica lekarska.

Jeżeli dziennikarz kontaktuje się ze źródłem — działa ochrona źródeł informacji.

Ale chatbot AI nie jest ani adwokatem, ani lekarzem, ani dziennikarzem.

To system technologiczny należący do konkretnej firmy.

I właśnie dlatego pojawia się problem.

Co ludzie wrzucają dziś do AI?

Znacznie więcej, niż mogłoby się wydawać.

Eksperci ds. cyberbezpieczeństwa od miesięcy alarmują, że użytkownicy bardzo szybko przekroczyli granicę zdrowego rozsądku.

Do modeli AI trafiają między innymi:

- projekty kontraktów,

- dane klientów,

- poufne dokumenty firmowe,

- strategie marketingowe,

- dane finansowe,

- dokumentacja medyczna,

- informacje kadrowe,

- pisma procesowe,

- treści przetargów,

- dane osobowe mieszkańców i klientów.

Często dzieje się to bez wiedzy działów prawnych czy administratorów bezpieczeństwa informacji.

Pracownik chce „ułatwić sobie pracę”.

Kopiuje dokument.

Wkleja do AI.

Prosi o analizę albo poprawę.

I w praktyce może właśnie przekazywać dane podmiotowi zewnętrznemu.

Dlaczego to może mieć znaczenie w sądzie?

Bo sąd nie patrzy wyłącznie na intencję użytkownika. Patrzy również na przepływ danych.

Jeżeli w toku sporu okaże się, że:

- firma przesyłała poufne informacje do zewnętrznego systemu AI,

- urzędnik analizował dane mieszkańców w publicznym modelu,

- kancelaria wrzucała dokumenty klientów do chatbota,

to druga strona może próbować podważać:

- zachowanie poufności,

- ochronę tajemnicy przedsiębiorstwa,

- zgodność z RODO,

- procedury bezpieczeństwa.

A w niektórych przypadkach może pojawić się także wniosek o zabezpieczenie lub ujawnienie określonych danych.

To właśnie dlatego temat zaczyna interesować prawników na całym świecie.

Firmy zaczynają rozumieć skalę problemu

Jeszcze niedawno AI było traktowane głównie jako narzędzie produktywności. Dziś coraz częściej trafia pod nadzór działów compliance i cyberbezpieczeństwa.

Duże organizacje zaczynają wprowadzać:

- zakazy używania publicznych modeli AI,

- wewnętrzne regulaminy korzystania z chatbotów,

- klasyfikację danych,

- prywatne modele AI,

- rozwiązania self-hosted,

- systemy działające lokalnie w infrastrukturze firmy.

Powód jest prosty.

Przedsiębiorstwa zrozumiały, że AI nie jest już tylko „asystentem do pisania”.

To nowy kanał przepływu informacji.

I potencjalne ryzyko wycieku.

Europa i RODO dopiero wchodzą w ten temat

W Unii Europejskiej problem komplikuje dodatkowo RODO.

Jeżeli użytkownik wrzuca do AI:

- dane osobowe,

- PESEL,

- dane medyczne,

- informacje klientów,

- dokumentację pracowników,

to pojawia się pytanie:

na jakiej podstawie prawnej te dane są przetwarzane?

I czy administrator danych w ogóle ma świadomość, że pracownik używa AI?

Eksperci zwracają uwagę, że wiele organizacji nie ma dziś żadnych procedur dotyczących sztucznej inteligencji. Tymczasem pracownicy korzystają z niej codziennie — często prywatnie, z własnych kont.

Urzędy i samorządy też mogą mieć problem

Temat może być szczególnie ważny dla administracji publicznej.

W wielu urzędach AI zaczyna być wykorzystywana do:

- redagowania pism,

- analiz dokumentów,

- przygotowywania odpowiedzi,

- opracowywania materiałów informacyjnych.

Pytanie brzmi:

czy wraz z tym do modeli AI trafiają również dane mieszkańców?

Bo jeśli tak — konsekwencje mogą być bardzo poważne.

Zwłaszcza w sytuacji, gdy urząd korzysta z publicznych narzędzi bez jasno określonych procedur bezpieczeństwa.

Czy to oznacza, że nie wolno korzystać z AI?

Nie.

Ale kończy się epoka naiwnego zachwytu.

Jeszcze rok temu wiele osób traktowało AI jak „magiczny czat”. Dziś coraz wyraźniej widać, że to technologia, która wymaga dokładnie takich samych procedur bezpieczeństwa jak:

- poczta elektroniczna,

- systemy chmurowe,

- serwery firmowe,

- komunikatory biznesowe.

Eksperci zalecają przede wszystkim:

- niewrzucanie poufnych danych do publicznych modeli,

- anonimizację dokumentów,

- oddzielenie danych prywatnych od służbowych,

- stosowanie wersji enterprise,

- wdrażanie polityk bezpieczeństwa AI.

Bo największym zagrożeniem wcale nie jest sama sztuczna inteligencja.

Największym zagrożeniem jest przekonanie użytkowników, że rozmawiają z „prywatnym doradcą”, podczas gdy w rzeczywistości korzystają z narzędzia technologicznego działającego według określonych regulaminów i zasad przetwarzania danych.

Czy AI zmieni prawo i sądy?

Wiele wskazuje na to, że tak.

Prawnicy już dziś dyskutują o tym:

- czy rozmowa z AI jest dokumentem,

- czy może podlegać zabezpieczeniu procesowemu,

- kto odpowiada za dane wpisywane do modeli,

- gdzie kończy się automatyzacja, a zaczyna odpowiedzialność użytkownika.

I to prawdopodobnie dopiero początek.

Bo sztuczna inteligencja coraz częściej staje się:

- pamięcią firmy,

- cyfrowym konsultantem,

- analitykiem,

- notatnikiem strategicznym,

- miejscem podejmowania decyzji.

A to oznacza, że prędzej czy później stanie się również częścią sporów sądowych, kontroli i postępowań administracyjnych.

Pytanie nie brzmi już:

„czy AI zmieni sposób pracy?”

Pytanie brzmi:

czy prawo nadąży za tym szybciej niż użytkownicy zdążą popełnić kosztowne błędy?

Źródła i kontekst: publiczne analizy prawne dotyczące AI compliance, dyskusje wokół postępowań federalnych w USA, stanowiska ekspertów ds. cyberbezpieczeństwa oraz europejskich regulacji dotyczących ochrony danych i AI Act.

Czytaj dalej

Zostań przy sprawie

Wybraliśmy teksty, które naturalnie prowadzą czytelnika dalej.